Czy sztuczną inteligencję obowiązuje moralność i prawo autorskie? Na jakiej zasadzie działają algorytmy modeli i czy my, jako artyści, możemy się przed nimi chronić?

Z Pauliną znamy się od pierwszej klasy szkoły podstawowej. Obie lubiłyśmy rysować, tworzyłyśmy komiksy i ilustracje. Paulina zawsze była umysłem ścisłym: po latach została programistką AI. Postanowiłyśmy porozmawiać o tym, jak sprawa sztucznej inteligencji wygląda w oczach współczesnych artystów i programistów.

Kamila: Czy AI swobodnie pobiera dane z całego Internetu i generuje na ich podstawie? Czy może to zależy od ustawień i założeń twórcy oprogramowania?

Paulina: Bardzo niewiele programów bazujących na sztucznej inteligencji ma swobodny dostęp do Internetu. Większość modeli działa tylko na podstawie danych przygotowanych dla nich wcześniej. Oznacza to, że program ma jednorazowy dostęp do plików, które zostały skądś pobrane lub z wcześniej stworzonej bazy. Niewiele jest modeli, które ściąga dane z Internetu na bieżąco, ale to właśnie one robią najwięcej zamieszania i na ich temat jest najgłośniej w społecznym dyskursie.

Kamila: Dyskusja w Internecie jest tak chaotyczna i emocjonalna, że ciężko z różnych opinii i komentarzy wyłuskać co jest prawdą, a co kłamstwem. Temat praw autorskich jest w środowisku artystycznym sprawą niezwykle delikatną i trudną do rozwiązania nawet w sytuacji, gdy oskarżamy o plagiat jakąś osobę fizyczną. Tutaj jednak splagiatować może nas program; niektórzy twierdzą, że jeśli publikujesz coś (np. ilustrację) na social mediach, automatycznie przechodzi to na domenę publiczną, a ty tracisz prawa do decydowaniu o tym, co się z tymi obrazami stanie. Czy to prawda?

Paulina: Tak i nie. Zamysł jest taki, że chcemy umożliwić swobodne działanie np. uniwersytetom i pomóc im w działalności naukowej oraz badawczej, więc można wykorzystywać obrazy z tego typu platform. Głównym ograniczeniem jest czy model będzie wykorzystywany komercyjnie, a więc czy autor nie pobiera z tego tytułu wynagrodzenia. Idea jest słuszna, ale niestety otwiera furtki na różne interpretacje prawne.

Kamila: No właśnie, ale słowo "komercyjnie" ma tu jednak znaczenie kluczowe. Nikt nie ma pretensji do profesora na Uniwersytecie, że podczas swoich wykładów używa obrazów pobranych z Internetu – jeśli omawia np. dziedzinę współczesnej polskiej ilustracji musi posiłkować się jakimiś przykładami. W takim przypadku nie próbuje się takich prac drukować, sprzedawać czy kopiować, w przeciwieństwie do tego, jak "użytkują" programy AI inni ludzie. Bo jeśli ktoś generuje obraz hasłami "Kamila i Jakub Sobczakowie ilustracja mama z dzieckiem" to wiadomym jest, że chce stworzyć ilustrację w naszym stylu tak, by nam za to nie zapłacić.

Paulina: Generalnie jest tak, że istnieje bardzo brzydka furtka by ominąć ten problem i skomercjalizować model, który może robić takie rzeczy, czyli np. generować ilustracje na podstawie pliku pobranego od artysty. Co mam na myśli: jeżeli stworzysz model, czyli swoisty algorytm, który umie zinterpretować to, czego ty chcesz (np. dostaje dwa zdjęcia, jeden z portretem, drugi z ilustracją i ma stworzyć portret tej osoby w takim konkretnie stylu), to wagi tego modelu (czyli to w jaki sposób model interpretuje te zdjęcia) są ogólnodostępne lub da się je przybliżyć. Właśnie to jest problemem.

Chociaż nie możesz użyć tego konkretnego modelu bezpośrednio, to teoretycznie możesz wykorzystać to, że ten pierwszy model się czegoś nauczył i pokazać drugiemu, nowemu modelowi, żeby ten uczył się od tego pierwszego. Efekt końcowy prac wygenerowanych przez drugi model jest gorszy, ale może być używany w celach zarobkowych, bo niestety nikt nie udowodni jakie było pierwotne źródło danych. To sprowadza się do tego, że koniec końców możesz doprowadzić do sytuacji, w której rzeczywiście sprzedajesz prace innych osób.

Kamila: Doskonale widać, że prawo zwyczajnie nie nadąża za rozwojem tej technologii.

Paulina: Tak.

Kamila: Co w przypadku gdy naprawdę widać, że ktoś pokracznie wgrał do modelu nasze prace i na bazie tego wygenerował coś, co dosłownie czerpie z dużej części naszej twórczości? Kogo obciążyć za to winą i z kim walczyć: z osobą, która stworzyła ten program czy z osobą, która takie obrazki wygenerowała?

Paulina: Chciałabym, żeby miało sens walczyć z osobą, która stworzyła ten program: to ona powinna się upewnić, że taki plagiat będzie mało możliwy, ale jest to trudne do zrobienia i udowodnienia. Poza tym umiem sobie wyobrazić sytuacje, gdzie autor rzeczywiście nie miał złych intencji, a jego model został źle wykorzystany. No i przede wszystkim jak stwierdzić jaki procent jakiej pracy został ukradziony? Ile procent będzie wystarczającym dowodem dla sądu?

Niemniej, według mnie, do wykrywania plagiatu stworzonego z pomocą AI, powinno być wykorzystywane, o ironio, AI. Tak jest np. z fałszywymi wiadomościami w Internecie (tzw. false news): nieprawdziwe zdjęcia czy treści stworzone przez AI są również wykrywane przez programy AI i blokowane na mediach społecznościowych. Uważam, że Meta powinna zainwestować w model, który w ten sam sposób będzie blokował i zgłaszał prace, które zostały stworzone na bazie twórczości innych żyjących artystów.

Kamila: Masz na myśli, że algorytm analizowałby jaką część pracy jakiego artysty użył do wygenerowania obrazu konkretny model?

Paulina: Tak: i taki program wyliczałby jaki procent czyjejś pracy został użyty w pliku końcowym. Jeśli ten procent przekroczyłby ten ustalony przez platformę za legalny, taki obraz byłby automatycznie zgłaszany/blokowany/usuwany przez Instagrama albo Facebooka. Użytkownicy również mogliby wnioskować o użycie tego narzędzia na obrazach co do którego mają wątpliwości, że mogły być wygenerowane przy pomocy ich własnych prac, by zweryfikować, czy w istocie doszło do plagiatu. Ale tu potrzebna byłaby dobra wola Mety, może też jakieś rozporządzenia Unii Europejskiej, które unormowałyby to prawnie.

Kamila: Niektórzy podnoszą taki argument, że nie istnieje coś takiego jak indywidualny styl, więc nie można go ukraść. Takie osoby zwykle mylą jakiś styl ogólny (np. malarstwo impresjonistyczne, portret realistyczny), czyli pojęcia o szerokim znaczeniu, które rzeczywiście nie zostały stworzone przez jedną osobę, z twórczością typowo personalną. Jest różnica między generowaniem hasła: "słoneczniki w stylu malarstwa impresjonistycznego", a "słoneczniki w stylu malarstwa Vincenta van Gogha". W tym drugim przypadku żerujemy na doświadczeniu, twórczości i drodze artystycznej jednej osoby: drodze, której nam samym nie chciało się przejść. Lenistwo nie jest usprawiedliwieniem kradzieży: tym bardziej twórczości osób żyjących, których prace wciąż objęte są wszelkimi prawami autorskimi.

Paulina: Ciężko z perspektywy programisty jest wytłumaczyć modelowi jaki prompt byłby przesadą, plagiatem. Musielibyśmy dosłownie stworzyć do tego dane, żeby ktoś mógł ręcznie to zdefiniować i wtedy upewnić się, że takie pliki/treści nie będą mogły zostać do modelu wgrane lub zostać z niego wygenerowane.

Kamila: Domyślam się jak musiałoby być to trudne, bo trzeba by było myśleć w przód za kogoś: na co wpadnie jakiś desperat, który nie chce wydawać pieniędzy na ilustratora/twórcę, by ominąć zabezpieczenia. Trzeba by też wiedzieć jacy artyści nie należą do domeny publicznej, a także jak się nazywają: tutaj z pomocą mógłby przyjść Facebook i Instagram. Skoro możesz oznaczyć swoje konto jako "artysta", "muzyk", "twórca", mogłoby to pomóc w stworzeniu jakiegoś rodzaju identyfikacji (np. za pomocą dowodu osobistego), że jesteś osobą prawdziwą i zajmujesz się sztuką. Uważam, że powinny być dostępne opcje w ustawieniach, dzięki którym takie osoby mogłyby odmówić zgody na to, by ktokolwiek mógł pobierać zdjęcia i obrazy z ich kont.

Paulina: Dałoby się to tak częściowo ograniczyć, ale na pewno znalazłby się ktoś, kto próbowałby to obejść.

Kamila: Czy my, jako artyści, możemy jakoś pokazać użytkownikom używających AI do kradzieży tzw. środkowy palec? Co zrobić, by algorytm nie był w stanie sobie poradzić i właściwie przetwarzać naszych danych? Czy np. kadrowanie tak, by nie było widać całej pracy albo umieszczanie jej np. na mockupie (np. plakat jest w ramce w pokoju gdzie są różne przedmioty) w słabszej rozdzielczości może pomóc? Co ty, gdybyś chciała utrudnić jako artystka pracę AI zrobiłabyś, by publikowane przez ciebie prace miały jak najmniejsze szanse na udany plagiat?

Paulina: To trudne pytanie, musiałam długo nad nim pomyśleć. Kiedyś wiele prostych metod by zadziałało, typu dodanie tła czy znak wodny. Jednak w ciągu kilku lat temat modeli generatywnych, które właśnie zajmują się np. kopiowaniem stylu, poszedł bardzo do przodu i to zdecydowanie nie pomaga. Prawda jest taka, że to nieustanny wyścig zbrojeń i w tym momencie, jeżeli chcesz się jako artysta bronić przed AI, to musisz do tego wykorzystać AI.

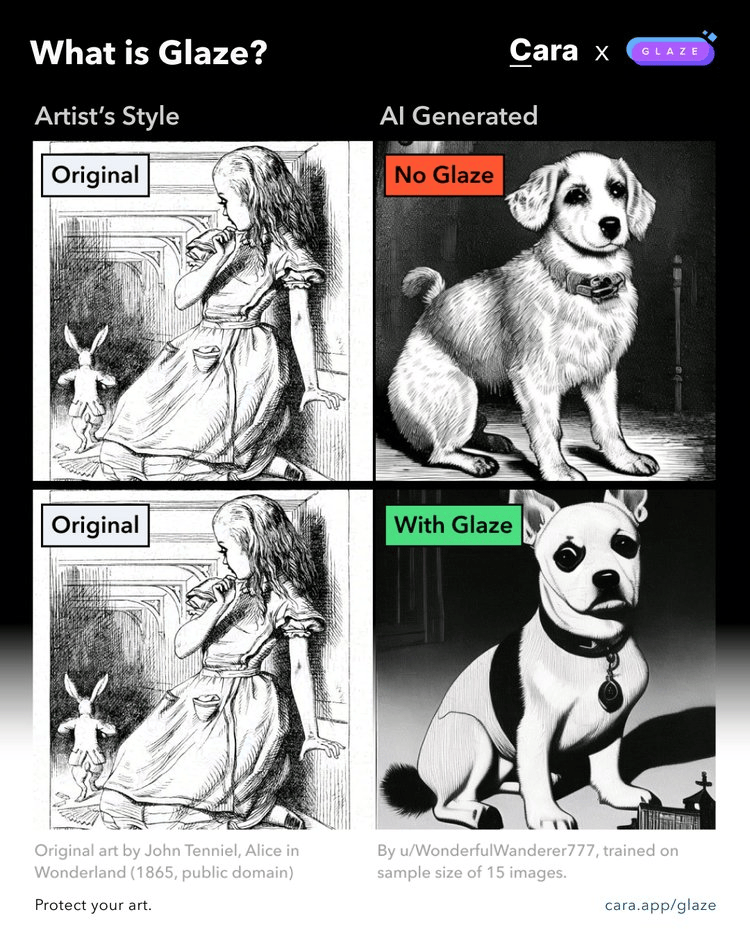

Kojarzę narzędzie Cara Glaze (https://blog.cara.app/blog/cara-glaze-about), które pozwala na zmianę zdjęcia tak, że dla odbiorcy wygląda praktycznie identycznie, jednak dla modelu odczytanie stylu robi się dużo trudniejsze. Z pewnością jest więcej takich narzędzi, ale o tym słyszałam i widzę, że rzeczywiście działa. Oczywiście z czasem także to narzędzie się przedawni i będzie potrzeba nowego, ALE na szczęście wielu programistów czy firm pamiętają o artystach i chcą ich chronić, więc z pewnością będą się wciąż pojawiały nowe :)

Paulina Leoniak, Lead Data Scientist w deepsense.ai

Kamila Sobczak, właścicielka Pracowni Kraska